Manual

do

Maker

.

com

A iminência das fake news com redes neurais

E lá pra mais de 2500 a.C. temos registros históricos de guerra, alguma coisa na região da Suméria. As guerras foram evoluindo, os armamentos; armas de combate direto, armas de ataque à distância, armas de fogo, ataque aéreo, terrestre, marinho, drones e enfim, a guerra digital. A guerra digital pode matar, afetar economias, roubar segredos de estado, militares ou simplesmente destruir a imagem de uma pessoa. Talvez seja a mais poderosa das guerras, e explico minha visão.

Pensemos na descoberta da roda. Antes, coisas pequenas que eram intransponíveis passaram a ser transportadas. Depois precisou-se de mais força, então entraram os esforços conjuntos de tração por escravos e quadrupedes (não sei se nessa ordem).

Em algum momento da história, inventaram a máquina a vapor! Tivemos carros, trens e então precisamos de mais força, mais autonomia e por fim, utilizamos combustíveis fósseis (também não sei se nessa ordem).

Oras, o homem viajava a pé, então a cavalo, depois de carro, de trem, mas ainda assim não podia ir a lugares remotos do planeta, então inventaram o avião. Inventaram carros potentes capazes de carregar grandes massas, aviões e trens de carga, a energia elétrica. Inventaram o telégrafo, o telefone, o pager, o celular, a Internet.

O que tem em comum nesse monte de invenções da humanidade? - A resposta é simples; o cérebro. A maior arma de todos os tempos sempre foi o cérebro. A capacidade de criar deu ao homem as comodidades da vida moderna, reduzindo os esforços físicos, aumentando sua letalidade, conferindo-lhe poder sobre grandes sociedades. E quais os limites? Será que já os atingimos? - Outra vez, a resposta é simples. Claro que ainda não.

Uma vez ouvi de alguém que "uma coisa só é impossível até que alguém a faça". O conjunto de pessoas que realmente fazem uso de suas capacidades mentais é limitado. Aprender, compreender e criar não são tarefas triviais. Grandes feitos não são para qualquer um, mas com feitos menores é possível se sobressair facilmente em diversos tipos de grupos de pessoas. Até mesmo nós de tecnologia, que lemos, estudamos e nos superamos diariamente, sequer temos conhecimento sobre todas as tecnologias que existem. Somos a plebe, sabemos aquilo que nos dizem aqueles que detêm o poder.

Daquilo que sabemos, temos os ataques digitais, que podem ser feito por meio de bots, ataque direto, engenharia social, fishing. E ainda recente, temos a inteligência artificial, que pode nos servir tanto para o bem quanto para o mal. Não estou me referindo à skynet, mas às chamadas deepfake, e agora (ainda sem um nome definido) a imitação da voz, reproduzida por uma inteligência artificial.

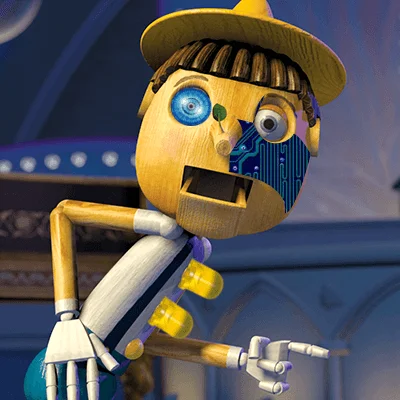

Para quem não conhece, deepfake reproduz de forma bastante satisfatória as expressões de uma pessoa, a partir de um modelo que assume seu papel. É parecido com a animação de filmes 3D, mas assustador, como você pode ver no vídeo. Evoluirá muito brevemente, sem dúvidas.

E estamos em um nível que já ultrapassou o porta retrato do Herry Potter. Com uma única imagem é possível fazer gifs ultrarrealistas!

Imagine se alguém pudesse juntar isso à voz do (agora) "alvo"? Pois é, já podem. Por ironia, foi a vez da Adobe mostrar a tecnologia.

O propósito pode ser excelente, como por exemplo recuperar falas importantes que contenham falhas, auxiliar na filtragem de som em produções cinematográficas. O deepfake pode auxiliar na recomposição de vídeo, pode servir para produzir espetáculos com pessoas que já partiram. O conjunto dos dois poderia imortalizar grandes nomes da história, tanto da arte quanto da ciência, fazendo apresentações para estudantes na voz e imagem do cientista. Mas tudo pode ter seu lado negro.

Hoje nos deparamos com diversos tipos de ataques à imagem, através de prints manipulados, imagens compostas em editores de imagem, pessoas fazendo boas imitações de vozes famosas e distribuindo por algum comunicador instantâneo ou redes sociais. Imaginem agora o poder que tem a conjunção do deepfake com áudio?

Imaginemos uma situação hipotética; um hacker consegue iniciar uma vídeo-conferência com autoridades, se passando por outra autoridade. Poderia ser uma patente militar dando ordem de ataque a uma tropa de prontidão. Poderia ser algo mais simples, como um dono de uma empresa dizendo a algum de seus subordinados para autorizar a entrada de um bandido na empresa.

Parece ficção, mas é a realidade atual, temos a tecnologia e ela só precisa ser bem ou mal empregada. Certamente veremos esse tipo de ataque em algum momento e sem dúvidas, de algum modo logrará êxito, porque ainda que hajam falhas perceptíveis, a intimidação psicológica não permitirá a um subordinado fazer análises, até que seja um protocolo.

As fake news serão fortemente beneficiadas, quanto mais simples e rápido se tornarem acessíveis as tecnologias. Inclusive, tenho em mãos um projeto funcional de deepfake, do qual pretendo escrever um artigo de uso em breve - o que já mostra a facilidade de acesso. Claro que para propósitos de aprendizado e de boas aplicações, mas uma caneta é uma arma na mão de um agressor.

Inscreva-se no nosso canal Manual do Maker no YouTube.

Também estamos no Instagram.

Djames Suhanko

Autor do blog "Do bit Ao Byte / Manual do Maker".

Viciado em embarcados desde 2006.

LinuxUser 158.760, desde 1997.